По информации ArsTechnica, исследователи представили алгоритм TurboQuant, способный кардинально снизить потребление памяти в системах искусственного интеллекта без потери точности, пишет Politexpert.

Новая разработка направлена на оптимизацию работы больших языковых моделей, которые обычно требуют значительных ресурсов для обработки данных и хранения промежуточных вычислений.

Как работает технология сжатия данных

TurboQuant решает проблему перегруженного кэша «ключ-значение», который используется для ускорения вычислений в нейросетях. Этот кэш можно сравнить с «шпаргалкой», где хранятся важные данные, чтобы не пересчитывать их заново.

Основной принцип алгоритма:

- преобразование данных в более компактную форму

- переход от стандартных координат к полярным

- уменьшение объёма хранимой информации без потери смысла

Система PolarQuant переводит сложные векторы в упрощённое представление, где остаются только ключевые параметры — направление и сила данных.

Два этапа обработки для точного результата

Технология включает два последовательных шага:

- первичное сжатие данных через PolarQuant

- корректировка ошибок с помощью метода QJL

Второй этап позволяет устранить неточности, которые могут возникать при сильном сжатии, сохраняя корректную работу моделей.

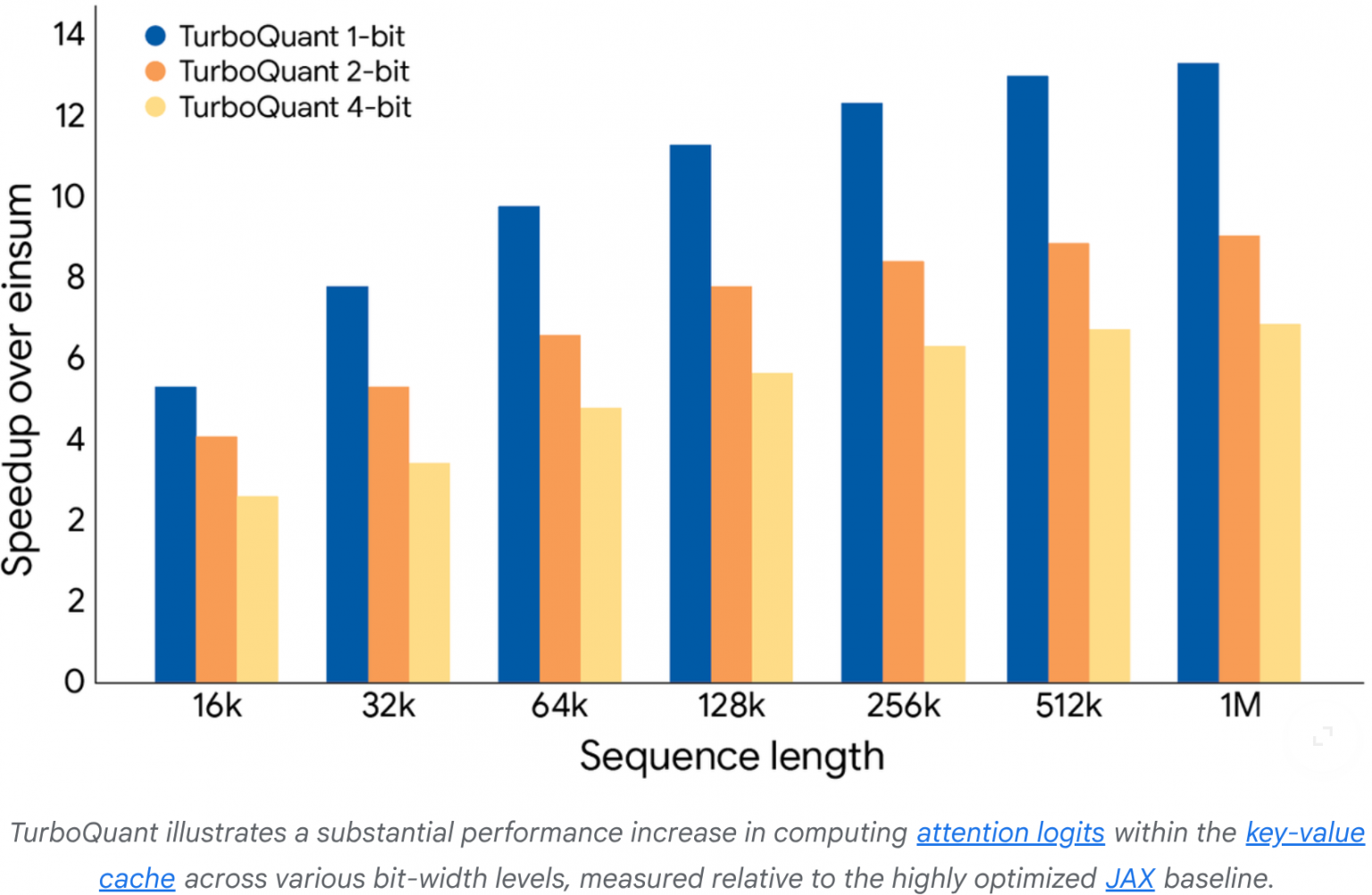

Какие результаты уже показали тесты

По данным разработчиков, технология демонстрирует заметные преимущества:

- сокращение потребления памяти до 6 раз

- ускорение вычислений до 8 раз

- сохранение качества обработки информации

Алгоритм может применяться к уже существующим моделям без дополнительного обучения, что упрощает его внедрение.

Как это повлияет на рынок и пользователей

Снижение требований к памяти может изменить подход к разработке и использованию ИИ:

- уменьшение стоимости работы моделей

- возможность запускать ИИ локально на устройствах

- снижение нагрузки на облачные сервисы

После анонса технологии на рынке уже зафиксировали реакцию — акции производителей памяти начали снижаться из-за ожиданий падения спроса.

Что изменится в будущем

Ожидается, что такие технологии позволят:

- запускать более мощные модели без увеличения затрат

- ускорить развитие мобильного ИИ

- повысить доступность сложных алгоритмов

При этом эксперты отмечают, что спрос на память полностью не исчезнет, но станет более сбалансированным.

Напомним, раньше мы писали про биографию Леонида Радвинского и его влияние на развитие платформы «OnlyFans» и цифровых сервисов.